Framework für neuronale Netzwerke

Mit Mathematica 12 wurde das hochrangige Framework für neuronale Netzwerke bezüglich seiner Funktionalität vervollständigt und dabei auch die Einfachheit und Leistung weiter verbessert. Insbesondere für die Verarbeitung sequenzieller Daten wie Text oder Audio wurde eine Vielzahl neuer Ebenen und Encoder hinzugefügt. Eine der wichtigsten Neuerungen ist die Einführung eines Modell-Repositorys, das eine Sammlung an vortrainierten Netzwerken enthält, die sofort einsatzbereit sind, aber auch symbolisch manipuliert oder präzise auf eine Aufgabe abgestimmt werden können. Des Weiteren wurde die Leistungsfähigkeit auf vielen Hardwarekonfigurationen verbessert, einschließlich der Möglichkeit, mehrere Grafikkarten für das Training zu verwenden. Damit vereint das Framework für neuronale Netze der Wolfram Language Einfachheit mit umfangreichen Funktionen ohne Leistungsbeeinträchtigungen für die Arbeit mit neuronalen Netzwerken.

- Zugriff auf vortrainierte Modelle »

- Definition und Visualisierung von beliebigen Netzwerken »

- Symbolische Bearbeitung von neuronalen Netzwerken »

- Zugriff auf detaillierte Trainingsinformationen »

- Messen der Netzwerkleistung »

- Trainieren von Netzwerken auf mehreren GPUs »

- Trainieren von Netzwerken mit Text- oder Audiodaten »

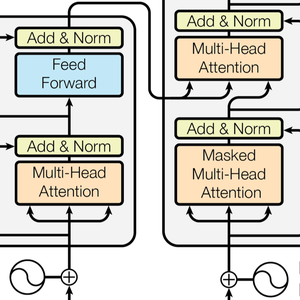

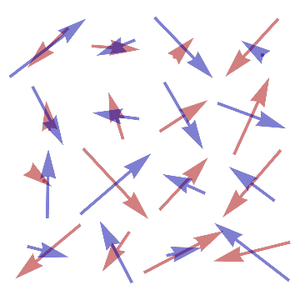

- Erzeugen von Aufmerksamkeitsmechanismen »

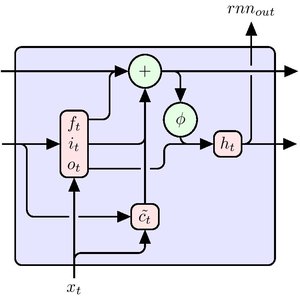

- Definieren von benutzerdefinierten, wiederkehrenden Ebenen »

- Effizientes Erzeugen von Sequenzen aus wiederkehrenden Ebenen »

- Training von Faltungsnetzen von Sequenzen »

- Training von Transformationsnetzen »

- Training von gekapselten Netzen »

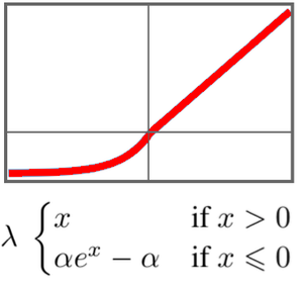

- Training von selbst-normalisierenden neuronalen Netzwerken »

- Zugriff auf bestärkende Lernumgebungen »